A Meta confirmou que segue investindo no desenvolvimento de chips próprios para inteligência artificial. A empresa divulgou novos detalhes sobre sua estratégia de hardware e indicou que continuará ampliando a linha de processadores da família MTIA, focados em tarefas de IA.

As informações mostram que a companhia intensificou o trabalho com ASICs, chips criados para funções específicas, com foco no desempenho em inferência de modelos de inteligência artificial.

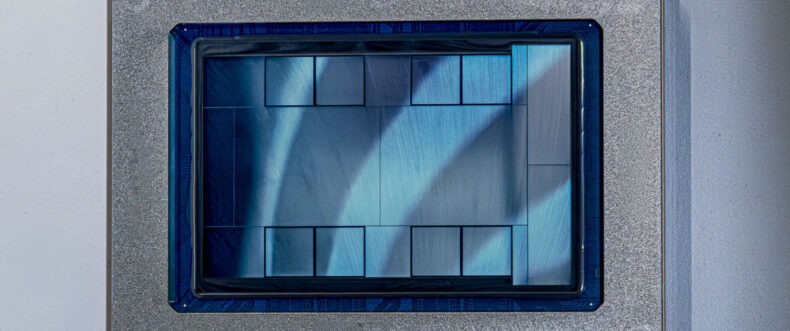

Segundo a empresa, a arquitetura usada nesses chips utiliza módulos chamados chiplets. Essa abordagem possibilita criar novas gerações de hardware com maior rapidez.

Com essa estrutura, a Meta pretende lançar quatro gerações de chips MTIA em apenas dois anos. O aumento da demanda por poder de processamento para IA tem levado grandes empresas de tecnologia a buscar alternativas além das GPUs tradicionais.

Fabricantes como a NVIDIA continuam dominando esse mercado, mas empresas de infraestrutura digital passaram a criar soluções próprias para cargas internas.

Outras gigantes de tecnologia, como Google e Amazon, também seguiram esse caminho com chips personalizados voltados para suas plataformas. De acordo com a Meta, o primeiro modelo dessa nova fase é o MTIA 300.

Esse chip foi projetado principalmente para tarefas de ranking e recomendação de conteúdo, sistemas usados em redes sociais e serviços digitais para organizar publicações, anúncios e sugestões ao usuário.

O componente inclui um chiplet de computação e dois chiplets de rede. Ele também usa memórias HBM com capacidade total de 216 GB e largura de banda de 6,12 TB/s.

A rede externa do sistema chega a 200 GB/s. O MTIA 300 serviu como base para o desenvolvimento do MTIA 400, que tem foco maior em desempenho bruto.

Segundo a empresa, essa geração registra aumento de cerca de 400% no desempenho FP8 em comparação ao modelo anterior, além de ganho de 51% na largura de banda da memória HBM.

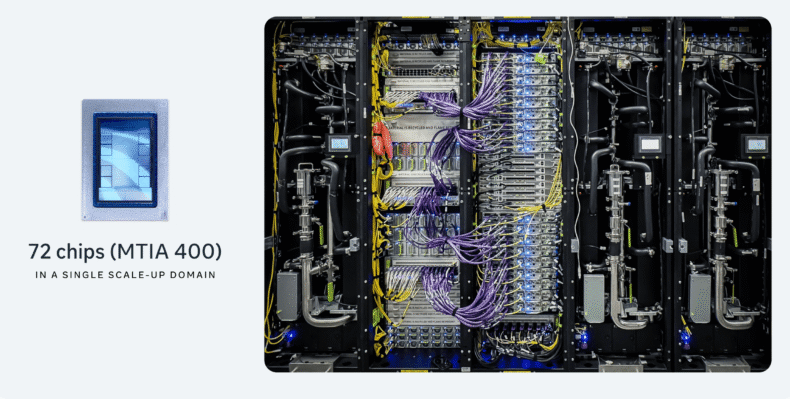

Esse chip funciona em uma configuração com até 72 unidades interligadas por um sistema de backplane comutado. A empresa já iniciou o processo de implantação desse modelo em sua infraestrutura.

A tabela abaixo mostra as principais características técnicas das quatro gerações anunciadas:

| Métrica | MTIA 300 | MTIA 400 | MTIA 450 | MTIA 500 |

|---|---|---|---|---|

| Foco de uso | Treinamento de ranking e recomendação | Uso geral | Inferência de IA generativa | Inferência de IA generativa |

| TDP do módulo | 800 W | 1200 W | 1400 W | 1700 W |

| Largura de banda HBM | 6.1 TB/s | 9.2 TB/s | 18.4 TB/s | 27.6 TB/s |

| Capacidade HBM | 216 GB | 288 GB | 288 GB | 384–512 GB |

| Desempenho MX4 | — | 12 PFLOPs | 21 PFLOPs | 30 PFLOPs |

| Desempenho FP8 / MX8 | 1.2 PFLOPs | 6 PFLOPs | 7 PFLOPs | 10 PFLOPs |

| Desempenho BF16 | 0.6 PFLOPs | 3 PFLOPs | 3.5 PFLOPs | 5 PFLOPs |

| Tamanho do domínio scale-up | 16 | 72 | 72 | 72 |

| Rede scale-up (largura de banda unidirecional) | 1 TB/s | 1.2 TB/s | 1.2 TB/s | 1.2 TB/s |

| Rede scale-out (largura de banda unidirecional) | 200 GB/s | 100 GB/s | 100 GB/s | 100 GB/s |

Os modelos MTIA 450 e MTIA 500 direcionam o desenvolvimento para inferência de IA generativa. Nesses chips, a empresa ampliou a capacidade e a velocidade das memórias HBM para lidar com volumes maiores de dados e modelos mais complexos.

A Meta também explicou que a estratégia de chiplets ajuda a acelerar a criação de novas versões. Em vez de redesenhar todo o processador a cada geração, a empresa troca apenas partes específicas do chip.

Esse método ajuda a manter um ritmo rápido de atualização do hardware. Nos últimos meses, surgiram informações indicando que a Meta poderia abandonar o desenvolvimento de chips próprios após firmar acordos com a NVIDIA para uso de GPUs.

Mesmo assim, os anúncios mais recentes mostram que a empresa continua apostando em hardware interno para inteligência artificial.

- Leia tambem: Apple perde executiva-chave de IA para a Meta

A companhia afirmou que todas as quatro gerações de chips MTIA citadas no plano atual devem entrar em operação entre 2026 e 2027, com o objetivo de reduzir limitações de processamento em seus centros de dados.

Os novos anúncios mostram que a Meta mantém o plano de criar chips próprios para inteligência artificial e pretende ampliar rapidamente essa linha de hardware.

A estratégia inclui quatro gerações da família MTIA em um intervalo curto, com foco em tarefas como recomendação de conteúdo e inferência de IA generativa.

O uso de chiplets ajuda a acelerar o desenvolvimento e permite atualizações frequentes, enquanto a implantação prevista até 2027 busca ampliar a capacidade de processamento nos data centers da empresa.