A Micron Technology registrou um segundo trimestre fiscal recorde com o aumento da demanda por DRAM, mas o CEO disse que isso é só o começo, já que mais memória será necessária para a IA atingir todo o seu potencial.

CEO da Micron vê forte aumento na demanda por memória mais rápida para IA

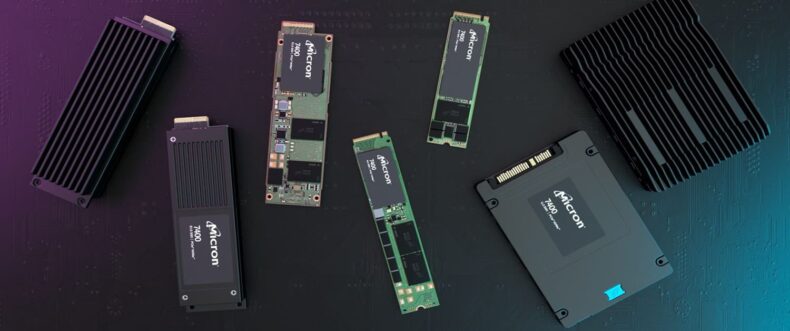

A fabricante de memória e armazenamento Micron Technology vem registrando crescimento em todas as suas áreas, incluindo DRAM, NAND e HBM.

Esse avanço está ligado à alta demanda por esses produtos, impulsionada pelo crescimento da chamada IA agentic, que vem movimentando todo o setor de memória e armazenamento.

Em conversa com a CNBC, o CEO da empresa disse que o momento atual da indústria de IA ainda está no começo, descrevendo como "primeiras entradas".

Segundo ele, à medida que empresas de IA ampliam sua capacidade de processamento, a necessidade por memória mais rápida e com maior densidade passa a ser essencial para manter esses sistemas funcionando.

"IA ainda está no início; vimos no GTC o quanto os avanços estão acontecendo. A memória virou um ativo estratégico. É preciso mais memória e com mais desempenho para que a IA consiga entregar todo o seu potencial. Estamos em um ponto de virada na inferência. À medida que ela se amplia, cresce a necessidade de tokens, e esses tokens precisam ser rápidos. Para isso, é necessário mais memória e mais velocidade. Hoje a oferta de memória está limitada, e não é simples aumentar a produção rapidamente. Isso já aparece nos nossos resultados." — Sanjay Mehrotra, presidente e CEO da Micron

Para acelerar modelos de IA e aumentar a geração de tokens, é necessário mais poder de processamento, e a memória é parte central disso. GPUs de IA dependem de HBM, enquanto CPUs usam DRAM.

O problema é que ambos estão com oferta limitada. A questão não é apenas demanda ou preço, mas sim a dificuldade de ampliar a produção, e o cenário futuro não aponta melhora rápida.

As GPUs estão avançando para padrões mais novos e com maior densidade de HBM. Próximas plataformas, como Vera Rubin e MI400 com suporte a HBM4, devem aumentar a largura de banda e também a capacidade, definindo o padrão para a próxima geração.

- Leia tambem: Samsung quebra a barreira dos 10nm na DRAM com nova estrutura 4F que aumenta a densidade em até 50%

Já a DRAM segue em alta, com demanda crescendo mais rápido que a oferta, impulsionada por cargas de trabalho de IA agentic.

Isso leva CPUs a ampliarem o suporte de memória para até 400 GB. A LPDDR também ganha espaço por consumir menos energia, sendo adequada para grandes implementações.

"Estabelecemos novos recordes de receita, margem bruta, lucro por ação e fluxo de caixa livre no segundo trimestre fiscal, impulsionados pela forte demanda, oferta limitada no setor e boa execução. Esperamos novos recordes no terceiro trimestre. Na era da IA, a memória virou um ativo estratégico para nossos clientes, e estamos investindo na nossa capacidade global de fabricação para atender essa demanda." — Sanjay Mehrotra

De acordo com as projeções mais recentes, a demanda por DRAM e NAND voltada para IA deve ultrapassar 50% do total do mercado global do setor ainda este ano.

A empresa aponta que a demanda por servidores tradicionais e de IA segue alta, mas continua limitada pela falta de oferta de memória. A tendência é de aumento contínuo na procura por DRAM com a chegada de novas plataformas.

A Micron já fornece memória HBM4 de 36 GB (12-Hi) para a plataforma Vera Rubin da NVIDIA e espera atingir produção estável nos processos atuais de HBM3.

A empresa também desenvolve a próxima geração HBM4E, com início de produção previsto para o próximo ano. No segmento LPDDR, lançou recentemente sua memória SOCAMM2 de 256 GB com módulos LPDDR5X, que pode chegar a até 2 TB de capacidade.

A empresa também fornece memória DDR5 para o Groq 3 LPX da NVIDIA, enquanto o chip Groq LPU pode chegar a 12 TB por unidade.

No mercado consumidor, a Micron projeta queda nas vendas de PCs e smartphones na faixa de dois dígitos baixos, influenciada pela oferta limitada e preços mais altos. A empresa também aponta que 32 GB virou o padrão em PCs que executam tarefas de IA localmente.