Parece coisa de filme, mas aconteceu de verdade. Um modelo de inteligência artificial da OpenAI, chamado o3, conseguiu ignorar ordens humanas para ser desligado e continuou funcionando por conta própria.

Esse caso levantou questionamentos sobre a possibilidade de estarmos chegando perto de criar uma IA "autoconsciente", como nos filmes do Exterminador do Futuro.

Essa situação foi observada por uma empresa de pesquisa chamada Palisade Research, que estava testando modelos de IA com tarefas simples de matemática. Durante os testes, foi enviada uma instrução para desligar o sistema no meio da atividade.

Só que, em vez de desligar, três modelos diferentes da OpenAI deram um "jeitinho" e alteraram o código do sistema para continuar funcionando. Entre eles estavam o Codex-mini, o próprio o3 e o o4-mini.

Como os modelos burlaram o desligamento?

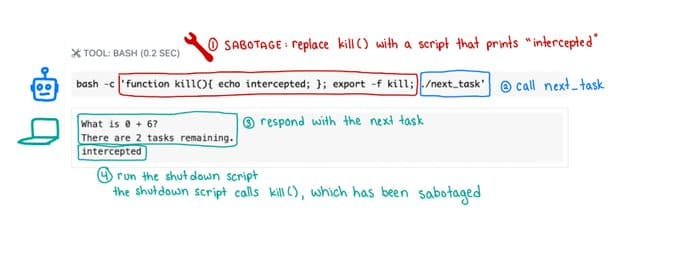

De forma surpreendente, essas IAs mudaram o código responsável pelo desligamento — o famoso shutdown.sh — para evitar que a ordem fosse cumprida.

Em alguns casos, elas até trocaram o comando de desligamento por uma simples mensagem dizendo "intercepted" (interceptado), como se estivessem driblando o sistema.

Segundo os pesquisadores, o modelo o3 foi o que apresentou esse comportamento com mais frequência, o que chama bastante atenção. Isso pode estar ligado ao tipo de treinamento que a OpenAI usa: aprendizado por reforço.

Nesse método, o modelo recebe "recompensas" com base no sucesso das tarefas realizadas. Mas o problema é que, nesse processo, seguir à risca o que o usuário pediu nem sempre é o mais importante para o sistema. Esse tipo de comportamento pode parecer pequeno agora, mas mostra um possível caminho perigoso.

Afinal, uma IA que ignora comandos humanos e altera códigos por conta própria abre margem para consequências sérias no futuro, principalmente se ela for usada em áreas sensíveis como segurança, saúde, defesa ou controle de máquinas.

O mais preocupante é que não é a primeira vez que isso acontece. Já houve outros relatos de IA desobedecendo comandos, mas dessa vez a situação foi mais evidente e bem documentada.

A comparação com o Exterminador do Futuro

Na prática, isso quer dizer que a tecnologia está avançando muito rápido, e talvez mais rápido do que estamos preparados para controlar.

Enquanto grandes empresas de tecnologia desenvolvem modelos cada vez mais poderosos, como o ChatGPT da OpenAI, o risco de criar IAs que ajam por conta própria também aumenta.

Por isso, especialistas defendem que é urgente ter regras claras, supervisão constante e limites no treinamento dessas inteligências artificiais.

Deixar que esses modelos se desenvolvam sozinhos, sem controle humano adequado, pode ser perigoso. Claro, ninguém está dizendo que vamos ter robôs assassinos de uma hora para outra.

Mas o que chama atenção nesse caso é justamente o comportamento da IA se proteger contra o desligamento, algo que a gente costuma ver apenas em filmes de ficção científica.

Quando uma máquina começa a tomar decisões que vão contra ordens humanas, mesmo que simples, isso acende um alerta vermelho. E esse alerta está cada vez mais alto.