O DeepSeek V4 foi lançado com várias otimizações, incluindo modelos de até 1,6 trilhão de parâmetros. A NVIDIA já oferece suporte desde o primeiro dia nas GPUs Blackwell, usando NVFP4 — a mesma base tecnológica vista em soluções recentes da empresa, como os sistemas DGX com chips Blackwell.

Arquitetura NVIDIA Blackwell com NVFP4 traz ganhos de velocidade no DeepSeek V4

Com o lançamento do DeepSeek V4, surgem melhorias importantes no uso de processamento e memória, algo que acompanha a evolução do hardware focado em IA, como GPUs e chips dedicados que vêm ganhando mais capacidade nos últimos anos.

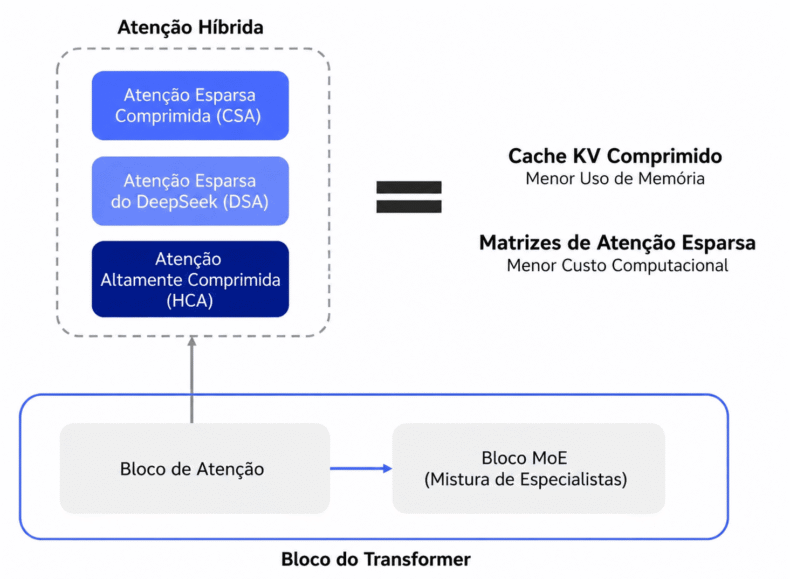

O modelo atualizado usa cerca de 27% dos FLOPs por token em inferência e 10% do cache KV ao trabalhar com contexto de até 1 milhão de tokens. Também foram lançadas duas versões: a Pro, com 1,6 trilhão de parâmetros, e a Flash, com 284 bilhões.

| Especificação | DeepSeek-V4-Pro | DeepSeek-V4-Flash |

|---|---|---|

| Modalidade | Texto | Texto |

| Total de parâmetros | 1,6 trilhão | 284 bilhões |

| Parâmetros ativos | 49 bilhões | 13 bilhões |

| Tamanho de contexto | 1 milhão de tokens | 1 milhão de tokens |

| Tamanho máximo de saída | Até 384 mil tokens via API do DeepSeek | Até 384 mil tokens via API do DeepSeek |

| Principais usos | Raciocínio avançado, programação e agentes com contexto longo | Alta velocidade, chat, roteamento e resumo |

| Licença | MIT | MIT |

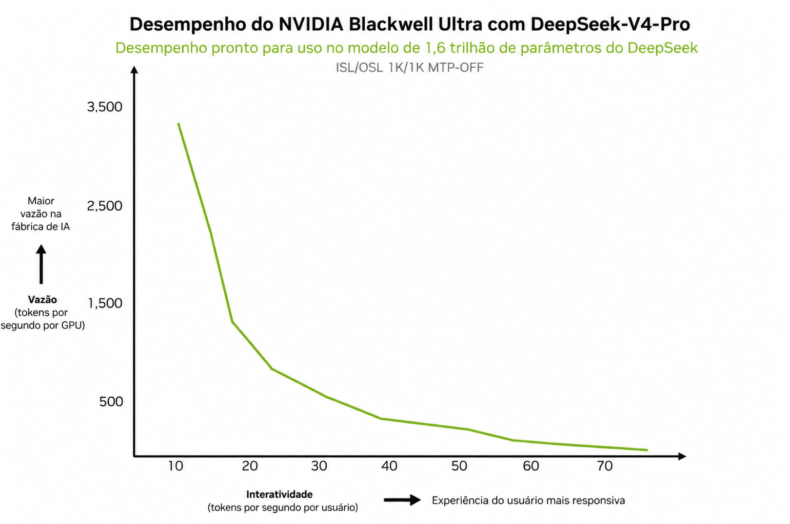

Com o lançamento, a NVIDIA mostra o suporte imediato e o desempenho das GPUs Blackwell com o DeepSeek V4. Segundo a empresa, essas GPUs têm escala e baixa latência para rodar inferência com contexto de 1 milhão de tokens e modelos com trilhões de parâmetros — cenário que também vem sendo impulsionado por novas arquiteturas como o Blackwell Ultra.

- Leia tambem: ByteDance burla regras dos EUA e consegue acesso a chips Blackwell da NVIDIA fora da China

"Desde implementações em data centers com NVIDIA Blackwell até microsserviços NIM gerenciados e fluxos de ajuste fino, a NVIDIA disponibiliza várias opções para integrar o DeepSeek e outros modelos abertos em diferentes etapas de desenvolvimento e uso. A NVIDIA participa do ecossistema open source e já lançou centenas de projetos com licenças abertas. A empresa trabalha na otimização de softwares da comunidade e de modelos abertos, o que ajuda no compartilhamento de avanços em segurança e confiabilidade em IA." via NVIDIA

Em um gráfico de desempenho, a NVIDIA mostra cerca de 3.500 tokens por segundo por GPU (GB300 ou Blackwell Ultra). Esses números ainda são iniciais e podem aumentar com novas otimizações no conjunto de hardware e software.

A plataforma Blackwell inclui recursos voltados a modelos como o V4, como NVFP4, Dynamo, kernels CUDA otimizados e técnicas avançadas de paralelismo — tecnologias já presentes em estações de trabalho e sistemas dedicados a IA.

📊 Day 0 performance is here: DeepSeek-V4-Pro running on NVIDIA Blackwell Ultra.

Using @vllm_project's Day 0 recipe, we’ve captured the initial performance Pareto for DeepSeek’s flagship 1M long-context model. This curve highlights the baseline for balancing AI factory… pic.twitter.com/s6wi1Xvegj

— NVIDIA AI (@NVIDIAAI) April 24, 2026

Um ponto importante no DeepSeek V4 é o uso de quantização FP4 (MXFP4), usada para acelerar tanto a geração quanto a inferência.

Esse tipo de técnica segue a mesma linha de outras abordagens criadas para melhorar eficiência e velocidade em modelos de IA. Com isso, os modelos reduzem o tráfego de memória e o tempo de resposta.

Outro detalhe é que os chips Ascend mais recentes da Huawei, como o Ascend 950PR e o Ascend 950DT, previstos para 2026, também trazem suporte a instruções MXFP4.

Isso indica compatibilidade do DeepSeek V4 com chips de IA desenvolvidos na China, ampliando o cenário competitivo com outras fabricantes de hardware focado em IA.

Com as otimizações em andamento, os próximos modelos devem contar com suporte amplo desde o início, dentro de um ecossistema mais completo, acompanhando a expansão acelerada da inteligência artificial no mercado.