As unidades centrais de processamento, conhecidas como CPUs, estão presentes em praticamente todos os equipamentos digitais atuais. Elas aparecem em celulares, computadores pessoais, servidores e consoles de jogos.

Ao longo de mais de cinco décadas, a arquitetura desses processadores mudou bastante. O desenvolvimento aconteceu com foco em maior desempenho, menor consumo de energia e adaptação a novos tipos de tarefas computacionais.

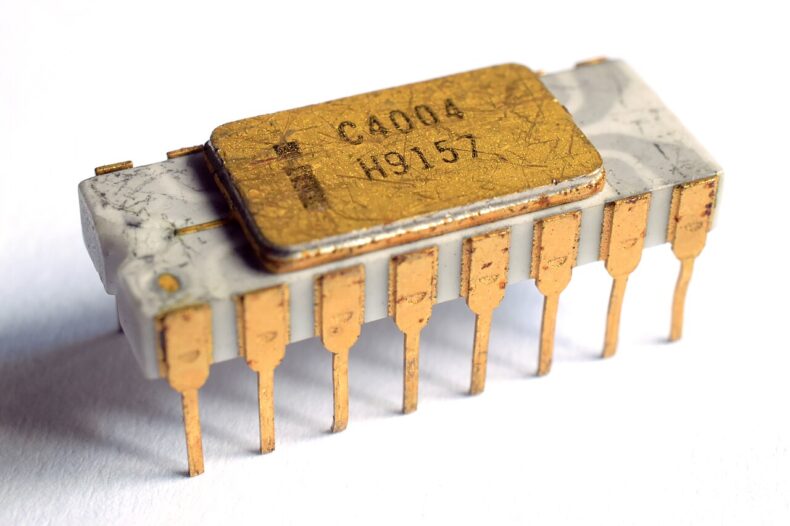

Essa evolução começou com o Intel 4004, considerado o primeiro processador comercial do mundo, e chegou aos sistemas complexos atuais usados por empresas como Intel, AMD e Apple.

O que é uma CPU

A CPU, também chamada de microprocessador ou simplesmente processador, é a parte do computador responsável por executar instruções de programas.

Em termos básicos, o funcionamento segue um ciclo conhecido como busca-decodificação-execução. Primeiro, o processador busca uma instrução na memória.

Em seguida, interpreta o que deve ser feito. Depois executa a operação e grava o resultado. Fisicamente, uma CPU é um circuito integrado composto por bilhões de transistores microscópicos.

Esses transistores funcionam como pequenos interruptores eletrônicos. Eles são construídos em um pedaço de silício por meio de um processo de fabricação extremamente preciso chamado fotolitografia.

Nesse método, camadas do wafer de silício recebem materiais sensíveis à luz e são expostas a padrões usando luz ultravioleta. O processo se repete diversas vezes até formar as estruturas completas do chip.

Graças a esse avanço industrial, foi possível colocar um número enorme de transistores em chips muito pequenos, o que contribuiu para o aumento constante de desempenho ao longo das décadas.

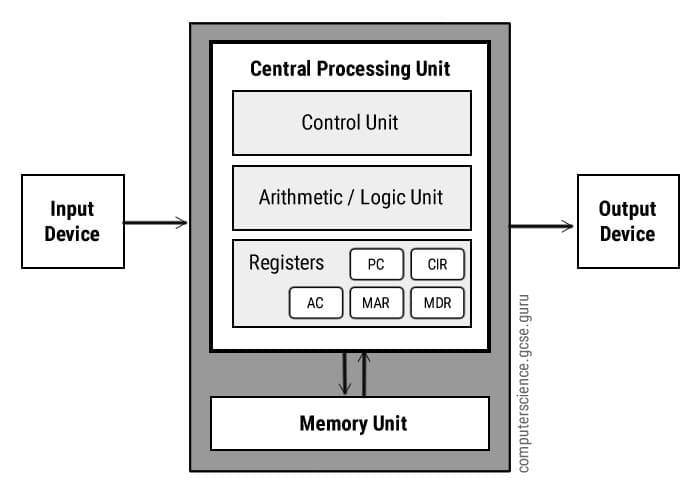

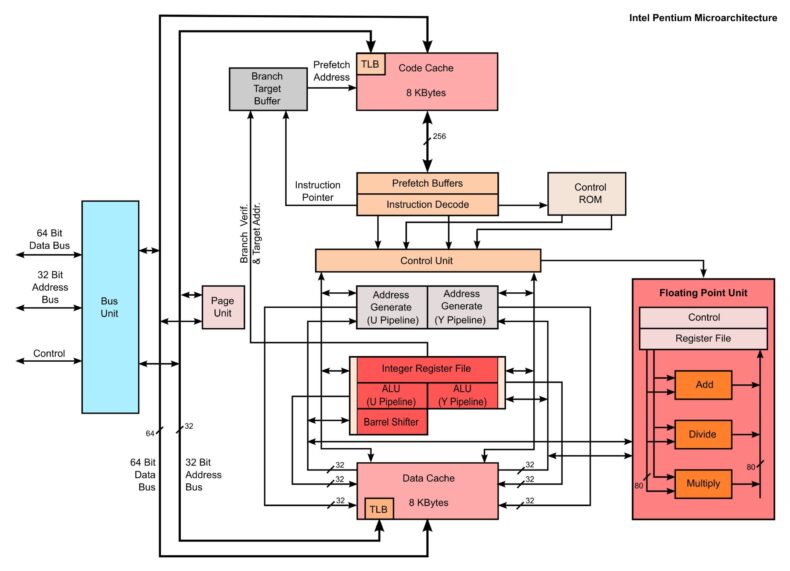

Como uma CPU moderna é organizada

Uma CPU atual não é apenas um único bloco que faz todo o trabalho. Ela reúne diversos componentes especializados que trabalham juntos para executar instruções com rapidez.

Entre os principais blocos estão o front-end, unidades de armazenamento temporário e unidades de execução. O front-end é responsável por buscar instruções na memória e interpretá-las.

Nesse estágio, um mecanismo recupera a instrução seguinte e um decodificador converte os dados em sinais internos que indicam qual operação deve ocorrer.

Existe também uma unidade de controle que coordena o fluxo de dados e organiza a execução das instruções dentro do processador. No centro de cada núcleo existem os registradores, que funcionam como pequenas áreas de memória extremamente rápidas.

Eles guardam os dados usados naquele momento durante os cálculos. O acesso a esses registradores é muito mais rápido do que acessar a memória principal ou até mesmo o cache.

Outro componente fundamental é a Arithmetic Logic Unit (ALU). Ela executa operações matemáticas inteiras e operações lógicas usadas em praticamente todos os programas.

Em processadores atuais, vários desses blocos podem existir ao mesmo tempo, o que possibilita executar múltiplas operações em paralelo. Quando o cálculo envolve números decimais, entra em ação a Floating Point Unit (FPU).

Nos primeiros computadores pessoais essa unidade podia existir como um chip separado, mas nos processadores atuais ela já faz parte de cada núcleo.

Há ainda unidades voltadas para movimentação de dados na memória, chamadas de Load/Store Units, e unidades responsáveis por calcular endereços de memória.

Muitas CPUs também possuem unidades vetoriais ou SIMD, que executam a mesma operação em vários dados ao mesmo tempo. Isso acelera tarefas como multimídia, criptografia e inteligência artificial.

Para reduzir o tempo de acesso à memória principal, os processadores utilizam memórias intermediárias chamadas de cache. Os níveis mais comuns são L1, L2 e L3.

Esses blocos armazenam cópias de dados utilizados com frequência para diminuir atrasos durante a execução. Todos esses componentes formam o caminho de dados e o sistema de controle da CPU, permitindo executar bilhões de instruções por segundo.

Outro conceito importante é o conjunto de instruções, chamado de Instruction Set Architecture (ISA). Esse conjunto define como o software se comunica com o processador, incluindo as instruções disponíveis, os tipos de dados e os registradores utilizados.

O nascimento da arquitetura x86

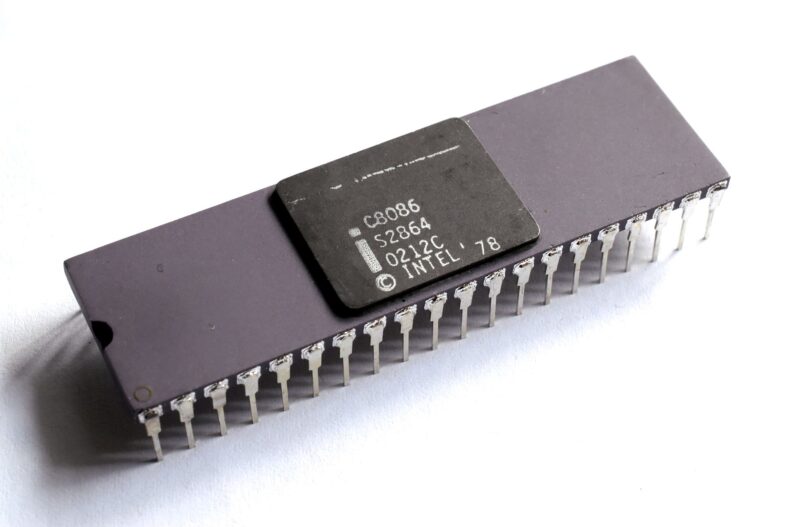

A história das CPUs usadas em computadores pessoais começou em 1978 com o Intel 8086. Esse chip originou a arquitetura x86, ainda dominante em computadores tradicionais.

Na época, muitos processadores domésticos eram de 8 bits, como o Intel 8080 e o Zilog Z80. O 8086 trouxe um salto ao trabalhar com arquitetura de 16 bits.

Ele possuía registradores internos de 16 bits e um barramento de dados também de 16 bits, além de um barramento de endereços de 20 bits que possibilitava acessar até 1 MB de memória, um valor elevado para o período.

Para lidar com essa capacidade de memória maior, a Intel adotou um modelo de segmentação que combinava registradores de segmento e deslocamentos de memória.

Esse método permaneceu presente na arquitetura x86 durante muitos anos. O chip tinha cerca de 29 mil transistores e era fabricado usando o processo HMOS da Intel.

Logo depois surgiu o Intel 8088, uma versão semelhante que usava barramento externo de 8 bits. Esse modelo foi escolhido para o computador IBM PC, lançado em 1981, o que ajudou a consolidar o padrão x86 no mercado de PCs.

Evolução do x86 nos anos 1980

Com o sucesso inicial, a Intel continuou aprimorando sua arquitetura durante a década de 1980. Um dos primeiros avanços veio com o Intel 80286, lançado em 1982.

Ele mantinha compatibilidade com programas antigos, mas expandia a capacidade de memória para até 16 MB e introduzia o chamado modo protegido, que adicionava mecanismos de proteção de memória e suporte a multitarefa.

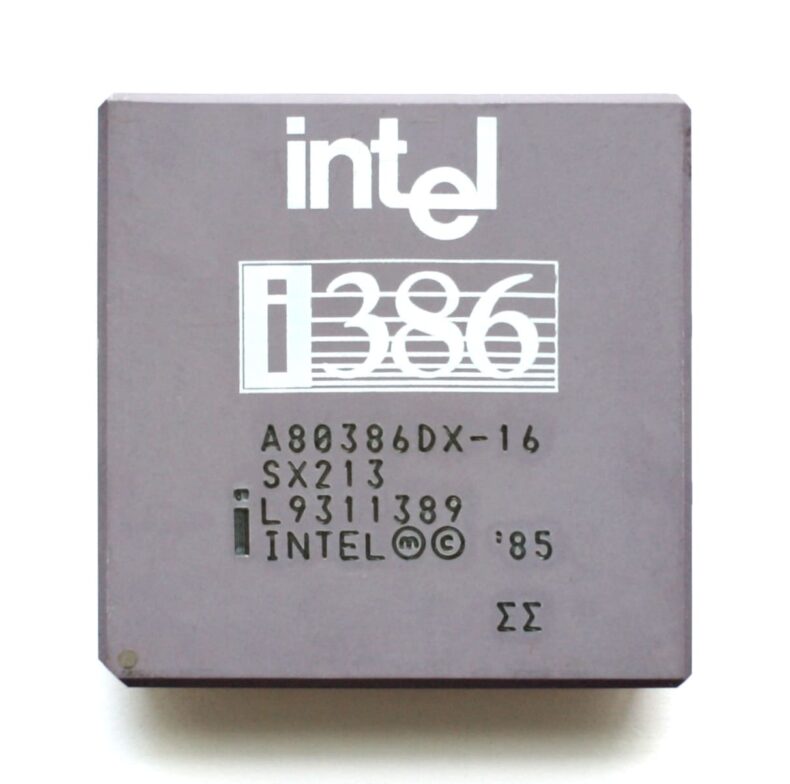

Em 1985 surgiu o Intel 80386, que marcou a transição para arquitetura de 32 bits. Esse processador ampliou os registradores e os caminhos de dados, além de dar acesso a até 4 GB de memória.

Ele também trouxe suporte a memória virtual, recurso usado por sistemas operacionais modernos. O passo seguinte foi o Intel 80486, lançado em 1989. O chip manteve a arquitetura de 32 bits, mas adicionou várias melhorias de desempenho.

Entre elas estavam a integração da unidade de ponto flutuante dentro do próprio processador, cache L1 interno e execução em pipeline, que pode sobrepor várias instruções durante o processamento.

A era do Pentium e o paralelismo

Nos anos 1990, o aumento de desempenho passou a depender menos apenas da frequência de clock. Os projetistas começaram a focar em executar várias instruções ao mesmo tempo.

Um marco dessa fase foi o Intel Pentium, lançado em 1993. Esse processador utilizava arquitetura superscalar, capaz de emitir mais de uma instrução por ciclo de clock.

Ele também incorporava técnicas de previsão de desvios, usadas para antecipar qual caminho um programa vai seguir durante a execução. Em 1995 chegou o Intel Pentium Pro, baseado na microarquitetura P6.

Ele introduziu execução fora de ordem, um método que reorganiza instruções internamente para manter as unidades de execução ocupadas mesmo quando algumas operações precisam esperar dados da memória.

Outro recurso importante foi a renomeação de registradores, que reduz dependências artificiais entre instruções e possibilita maior paralelismo. Essas técnicas passaram a formar a base da arquitetura de processadores modernos.

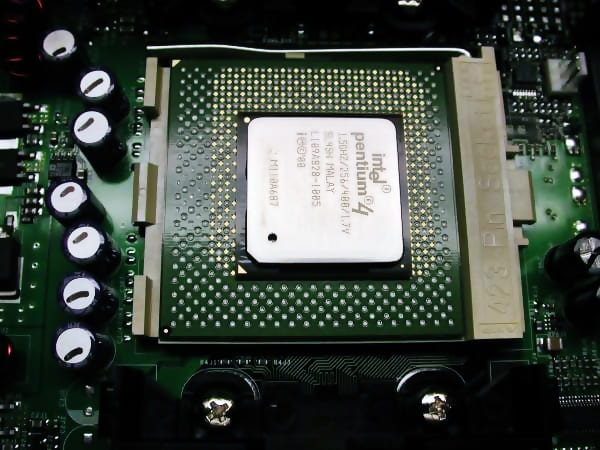

A corrida do GHz e o Pentium 4

No final dos anos 1990 e início dos anos 2000, o mercado passou a usar a frequência de clock como principal indicador de desempenho. A Intel apostou nessa estratégia com o Intel Pentium 4, lançado em 2000.

A microarquitetura NetBurst foi criada para atingir frequências muito altas. Para isso, o processador usava pipelines de execução bastante longos.

Apesar da intenção de chegar a clocks extremamente altos, essa abordagem trouxe efeitos negativos. O desempenho por ciclo diminuiu e erros na previsão de desvios causavam atrasos maiores.

Nesse período, processadores da AMD, como a linha AMD Athlon, muitas vezes superavam o Pentium 4 mesmo operando com frequência menor.

O experimento Itanium

Enquanto mantinha a linha x86, a Intel também desenvolveu um projeto diferente chamado Intel Itanium, criado em parceria com a Hewlett-Packard.

Lançado em 2001, ele usava uma arquitetura chamada EPIC. Nesse modelo, o compilador tentava identificar instruções que poderiam ser executadas em paralelo antes do programa rodar.

Na prática, extrair paralelismo de programas complexos mostrou-se difícil. Além disso, a falta de compatibilidade direta com softwares x86 dificultou a adoção.

Em 2003, a AMD introduziu a extensão x86-64, que trouxe suporte a 64 bits mantendo compatibilidade com programas existentes. A indústria adotou rapidamente esse caminho, o que limitou o alcance do Itanium.

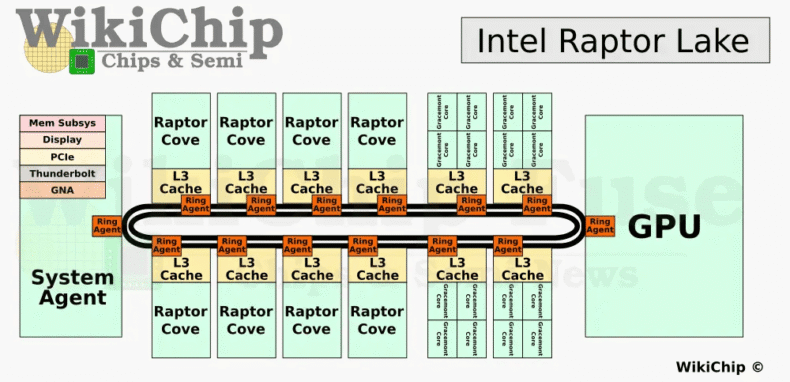

Processadores multicore e multithreading

No início dos anos 2000, o aumento de frequência começou a esbarrar em consumo de energia e calor. A solução encontrada foi aumentar o número de núcleos dentro do mesmo chip.

A transição começou com processadores de dois núcleos, como o AMD Athlon 64 X2, lançado em 2005. Com o tempo surgiram CPUs com quatro, oito ou até dezenas de núcleos.

Outra técnica usada para melhorar o uso dos recursos internos é o multithreading simultâneo. A Intel implementou essa tecnologia com o nome Hyper‑Threading, permitindo que um único núcleo execute várias threads ao mesmo tempo.

RISC e CISC

Durante as décadas de 1980 e 1990 houve debate entre dois modelos de arquitetura: CISC e RISC. A arquitetura x86 tradicionalmente é classificada como CISC, pois possui instruções complexas.

Já arquiteturas RISC usam instruções mais simples e execução mais rápida em pipeline. Um exemplo importante foi a arquitetura IBM POWER, que mais tarde deu origem ao PowerPC, utilizado em computadores da Apple e consoles de videogame por muitos anos.

Com o tempo, as diferenças diminuíram. Processadores x86 modernos convertem instruções complexas em micro-operações internas simples, aproximando o comportamento interno de um modelo RISC.

Avanços recentes: chiplets e SoCs

Com a desaceleração do avanço na miniaturização dos transistores, novas estratégias passaram a guiar a evolução das CPUs. Uma delas é o uso de chiplets.

Nesse modelo, o processador é formado por vários chips menores interligados, cada um responsável por funções específicas. Essa abordagem foi popularizada pela AMD com processadores baseados na arquitetura Zen.

Outro avanço importante está nas extensões vetoriais usadas para cálculos paralelos em grandes volumes de dados. Tecnologias como SSE, AVX e NEON ampliam a capacidade de processamento em tarefas de mídia, ciência e aprendizado de máquina.

Além disso, muitos processadores atuais são projetados como Systems-on-a-Chip (SoC). Nesse formato, CPU, GPU, controladores de memória e outros aceleradores ficam integrados no mesmo chip, diminuindo latência e consumo de energia.

Apple Silicon e a arquitetura ARM em desktops

Uma mudança importante no mercado aconteceu quando a Apple anunciou, em 2020, a transição dos computadores Mac para processadores próprios baseados em ARM. O primeiro modelo dessa geração foi o Apple M1.

Esses chips utilizam núcleos de alto desempenho com microarquiteturas muito amplas, capazes de decodificar várias instruções por ciclo. Eles também usam caches grandes e alto nível de integração entre CPU, GPU e outros aceleradores.

Esse modelo trouxe desempenho elevado por watt e demonstrou que arquiteturas ARM podem competir diretamente com processadores x86 em computadores pessoais.

Considerações finais

A evolução das arquiteturas de CPU mostra uma mudança contínua na forma como o desempenho é alcançado. Nas primeiras décadas, o avanço dependia principalmente do aumento de frequência e da miniaturização dos transistores.

Com o tempo, novas técnicas surgiram, como execução paralela, múltiplos núcleos, integração de componentes e uso de aceleradores especializados.

Atualmente, os processadores caminham para sistemas cada vez mais heterogêneos, nos quais CPU, GPU, aceleradores de inteligência artificial e outros blocos trabalham juntos dentro do mesmo chip.

Mesmo com todas essas mudanças, o objetivo continua sendo o mesmo desde os primeiros microprocessadores: executar instruções com mais rapidez, maior eficiência energética e em escalas cada vez maiores.