A NVIDIA foi uma das primeiras empresas a enviar os benchmarks do MLPerf Inference v6.0, registrando o maior desempenho em comparação com todos os concorrentes somados.

Quando o assunto é envio de benchmarks e demonstração da capacidade de suas plataformas, a NVIDIA costuma participar ativamente, principalmente no MLPerf, onde poucas empresas concluem o ciclo completo de testes.

Em publicação recente, a companhia comentou sua submissão ao MLPerf v6.0 e disse que, com o Blackwell Ultra e técnicas avançadas de co-design, alcançou o maior throughput de fábrica de IA e o menor custo por token.

Segundo a empresa, os resultados de inferência no MLPerf são nove vezes superiores ao concorrente mais próximo, indicando vantagem na infraestrutura.

Com o Inference v6.0, a equipe do MLCommons adicionou suporte a novos modelos de raciocínio e MoE, incluindo DeepSeek-R1, GPT-OSS-120B e Mixtral 8x7B.

A versão também foca em LLMs densos, recomendadores generativos e modelos de visão-linguagem, ampliando o alcance do benchmark para cargas de trabalho comuns em ambientes corporativos.

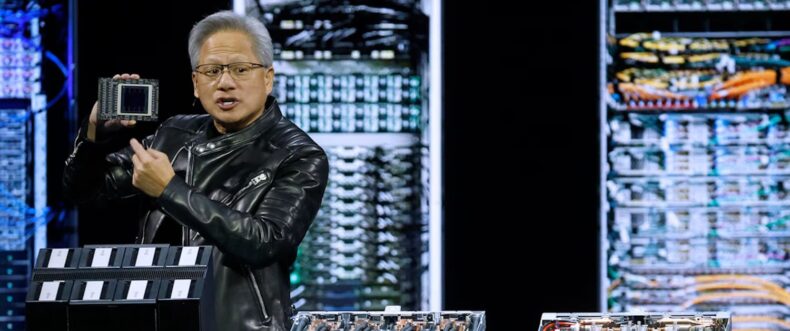

Por isso, Jensen Huang classificou o MLPerf como uma das suítes de testes mais exigentes. A seguir estão os resultados divulgados pela NVIDIA.

| Benchmark | GB300 NVL72 v5.1 | GB300 NVL72 v6.0 | Speedup |

|---|---|---|---|

| DeepSeek-R1 (Server) | 2,907 tokens/sec/GPU | 8,064 tokens/sec/GPU | 2.77x |

| DeepSeek-R1 (Offline) | 5,842 tokens/sec/GPU | 9,821 tokens/sec/GPU | 1.68x |

| Llama 3.1 405B (Server) | 170 tokens/sec/GPU | 259 tokens/sec/GPU | 1.52x |

| Llama 3.1 405B (Offline) | 224 tokens/sec/GPU | 271 tokens/sec/GPU | 1.21x |

Os números mostram vantagem nas métricas de tokens por segundo por GPU e indicam que parte do ganho vem de otimizações de software.

Desde a primeira submissão no benchmark DeepSeek-R1, há alguns meses, a NVIDIA registrou aumento de até 2,7x no throughput de tokens sem mudanças no hardware.

No nível de hardware, comparando com o GB200 NVL72, a empresa registrou até 2,77x de ganho no v6.0, indicando evolução entre gerações mesmo em testes exigentes como o MLPerf.

A NVIDIA também disser ser a única a enviar resultados com o DeepSeek-R1 no MLPerf Inference no ano passado. Com a nova versão, que adiciona novos critérios de análise, a vantagem com o Blackwell Ultra foi mantida.

Segundo a empresa, o throughput de inferência depende de co-design entre chips, arquitetura de sistema, estrutura de data center e software.

Os resultados do MLPerf Inference v6.0 indicam alto desempenho em diferentes cargas de trabalho, incluindo LLMs de grande porte, modelos de visão-linguagem e sistemas de recomendação generativa, dentro dos padrões da indústria.

A participação ativa da NVIDIA no MLPerf também é citada como um dos fatores que aumentam o interesse da comunidade de desenvolvedores.

Para quem não sabe, o MLPerf é uma suíte de testes exigente, e vários fabricantes de ASICs e até a AMD não participam com a mesma frequência.

Os resultados do Inference v6.0 também fortalecem a estratégia da empresa ao destacar métricas como custo por token e TCO em implementações de grande escala.

Os resultados do MLPerf Inference v6.0 indicam que a NVIDIA mantém vantagem em desempenho de IA, com ganhos ligados tanto a hardware quanto a otimizações de software.