A xAI estaria conseguindo usar pouco mais de 10% de todo o seu conjunto de GPUs da NVIDIA, segundo relatório que aponta limitações na otimização do software de IA.

Problemas no software de IA são comuns no setor, e a xAI consegue usar apenas 11% de toda a sua instalação de GPUs NVIDIA.

O site The Information informou que a xAI, empresa de software de Elon Musk por trás do Grok e de outros componentes de IA, utiliza só uma pequena parte da capacidade total de GPUs instaladas.

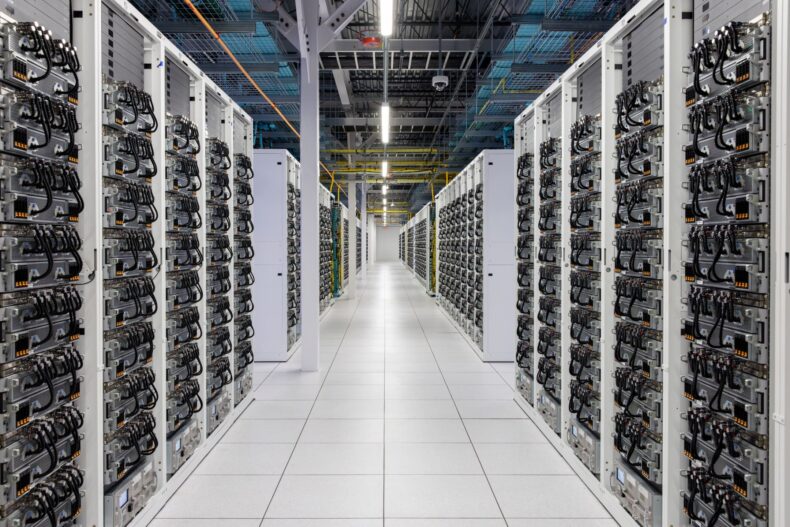

Hoje, a xAI opera cerca de 550 mil GPUs da NVIDIA, incluindo modelos H100 e H200. Esses chips estão distribuídos nos clusters Memphis e Colossus, com parte deles usando sistemas de resfriamento líquido.

xAI’s GPU fleet is running at about 11% utilization, exposing how hard it is for AI labs to fully use expensive Nvidia hardware.

Read more in our AI Agenda newsletter: https://t.co/32tIx6HLf8

— The Information (@theinformation) May 2, 2026

Mesmo sendo de uma geração anterior em relação à linha Blackwell, o volume de GPUs ainda chama atenção. Apesar da quantidade, a empresa usa apenas 11% das 550 mil GPUs.

Isso equivale a algo próximo de 60 mil unidades em uso, enquanto mais de meio milhão estão instaladas nos servidores. Mas o que causa esse gargalo?

Em estruturas menores, com 1.000 a 10.000 GPUs, isso não costuma ser um grande problema. Mas, quando a escala cresce para centenas de milhares de chips, o tempo ocioso aumenta rápido e o uso cai.

Isso gera falhas no conjunto de softwares, algo que aparece agora na xAI. Não é um caso isolado, já que essa dificuldade faz parte do setor de IA, onde manter eficiência em grande escala é complicado.

Algumas empresas investem pesado no software e conseguem taxas acima de 40%, dentro da média de 35% a 45%. A Meta e o Google são exemplos, com níveis de uso de cerca de 43% e 46%, respectivamente.

No caso da xAI, a rede de treinamento distribuído e o software ainda não estão totalmente prontos. Com isso, as GPUs ficam mais tempo paradas, e surgem gargalos frequentes no fluxo de dados e nas etapas de análise.

A empresa pretende aumentar essa taxa para 50%, mas não informou prazo. A mudança deve vir com ajustes na infraestrutura e melhorias no software.

A xAI também pode passar a oferecer aluguel de sua capacidade de GPUs, enquanto direciona novas demandas para hardware mais adequado a sistemas de IA com agentes.

Nesse cenário, Elon Musk segue investindo no projeto TeraFab, que inclui o desenvolvimento de chips próprios da linha "AI" e o uso da tecnologia 14A da Intel para criar soluções futuras para a xAI, SpaceX e outros negócios.

Existe ainda a possibilidade de que esse grande volume de GPUs seja usado em aplicações como jogos baseados em IA generativa.