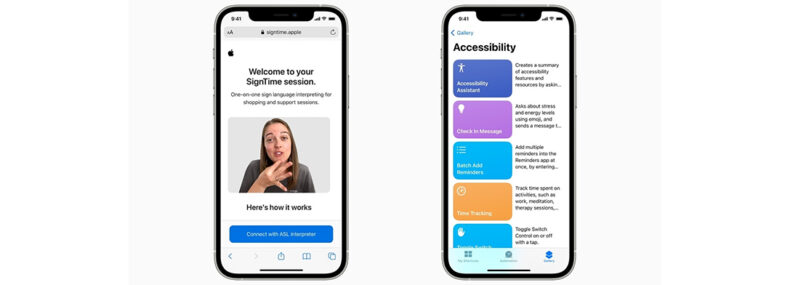

A Apple anunciou uma série de novos recursos projetados para pessoas com deficiência, incluindo um serviço de interpretação de linguagem de sinais individual chamado SignTime para compras e sessões de suporte.

O anúncio vem algumas semanas antes da Conferência Mundial de Desenvolvedores da Apple (WWDC), onde se espera o lançamento de atualizações para iOS, watchOS e iPadOS.

Alguns dos novos recursos incluem opções para Assistive Touch, VoiceOver, suporte para aparelhos auditivos e representação aprimorada relacionada à personalização do Memoji.

O último recurso representará usuários com tubos de oxigênio, implantes cocleares e um capacete macio para chapéus.

Quanto ao SignTime, o novo serviço está programado para ser lançado em 20 de maio nos Estados Unidos, Reino Unido e França, e deverá se expandir para outros países no futuro.

O novo recurso fornecerá às pessoas surdas e com deficiência auditiva acesso ao AppleCare e atendimento ao cliente varejista por meio da linguagem de sinais americana (ASL), da linguagem de sinais britânica (BSL) ou da linguagem de sinais francesa (FSL).

Estas novas ferramentas estarão disponíveis em atualizações em todas as plataformas da Apple ainda este ano.

A Apple também está trazendo o Assistive Touch para o Apple Watch para usuários com diferenças nos membros superiores.

Este recurso usará sensores de movimento integrados, como o giroscópio e o acelerômetro, junto com o aprendizado de máquina no dispositivo, para detectar diferenças sutis no movimento muscular.

Isso permitirá que os usuários controlem o Apple Watch, incluindo atender chamadas e acessar a Central de Notificações, sem nunca ter que tocar na tela ou nos controles.

Além disso, um novo recurso de suporte a rastreamento ocular para o iPad pode estar chegando. De acordo com a Apple, dispositivos MFi compatíveis rastrearão onde uma pessoa está olhando na tela e o ponteiro se moverá seguindo o olhar da pessoa.

O contato visual prolongado realiza uma ação, como um toque. A Apple também está apresentando uma atualização para o programa de dispositivos auditivos MFi, adicionando suporte para novos aparelhos auditivos bidirecionais.

- Leia tambem: Apple adquire todo o estoque disponível de LPDDR5 e força fabricantes chinesas a descontinuarem modelos topo de linha

Os microfones desses aparelhos auditivos permitirão que os surdos e com dificuldades de audição tenham conversas no viva-voz e no FaceTime.

A Apple também está trazendo suporte para reconhecimento de audiogramas para acomodações com fones de ouvido. Outra novidade é a introdução de um novo recurso de sons de fundo, que reproduz sons de fundo para mascarar ruídos ambientais indesejados.

A empresa disse que esses sons podem minimizar as distrações e ajudar os usuários a se concentrar, acalmar ou descansar. Alguns dos sons incluem "ruído equilibrado, claro ou escuro, sons do oceano, chuva ou riacho".

A Apple disse que esses sons se misturam ou se escondem em outros sons de áudio e de sistema. Finalmente, uma atualização permitirá que os usuários explorem imagens com o VoiceOver.

Com isso,, os usuários poderão explorar as imagens de maneira mais completa, incluindo detalhes sobre as pessoas, texto, dados da tabela e outros objetos dentro das imagens.

Para finalizar, a Apple revelou que esses novos recursos ultrapassam os limites da inovação e trazem a diversão e a função da tecnologia da Apple para um número ainda maior de pessoas.

"Acessibilidade é um direito fundamental e estamos sempre expandindo os limites da inovação para que todos possam aprender, criar e se conectar de novas maneiras", disse o CEO da Apple, Tim Cook, no Twitter.

Via: Apple News