"IA" é um dos termos mais saturados da tecnologia atualmente. Isso é curioso, porque a história real da área é bem mais interessante do que a versão resumida que aparece nas redes sociais.

Ao contrário do que muita gente pensa, a inteligência artificial não surgiu de uma única invenção e também não apareceu apenas quando o ChatGPT foi lançado. Na prática, a IA é resultado de décadas de avanços, tentativas frustradas e reinvenções.

Ao longo do tempo, o campo saiu de máquinas que tentavam "pensar" com lógica pura, passou por modelos estatísticos que aprendem com dados e chegou às Redes Neurais Artificiais (RNAs) e aos sistemas agentic atuais.

No centro dessa evolução existe uma disputa entre duas ideias: estruturas simbólicas explícitas e padrões estatísticos aprendidos. O interessante é que novas fases não substituem totalmente as anteriores.

Em vez disso, elas se complementam e voltam às mesmas perguntas fundamentais sobre como uma máquina deve representar o mundo ou lidar com incertezas.

Outro ponto importante é que "inteligência" não depende apenas de software. O avanço também veio da capacidade de processamento e da quantidade de dados disponíveis. A evolução da IA não aconteceu em linha reta, mas em ciclos.

Antes da IA ter nome

Muito antes de a inteligência artificial virar um campo formal, cientistas já estudavam formas de mecanizar o pensamento humano.

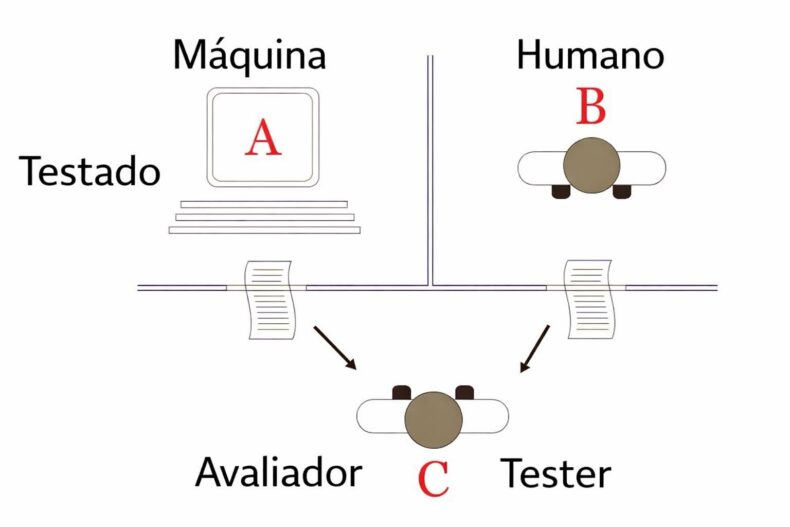

Em 1950, Alan Turing publicou o artigo Computing Machinery and Intelligence, que mudou o foco da pergunta "máquinas podem pensar?" para um teste prático de comportamento, hoje conhecido como Teste de Turing.

Na metade dos anos 1950, pesquisadores passaram a tratar a inteligência como um problema de engenharia, dividido em memória, busca e tomada de decisão.

Isso levou ao Dartmouth Workshop, considerado o nascimento oficial da inteligência artificial como disciplina acadêmica. Naquele momento, o otimismo era alto.

Muitos pesquisadores acreditavam que a inteligência artificial de nível humano surgiria em poucas décadas. Isso não aconteceu, mas o evento estabeleceu a IA como uma tentativa séria de simular inteligência humana com computadores.

IA clássica: lógica, regras e busca

A primeira grande fase, chamada de IA clássica ou simbólica, partia de uma ideia simples: inteligência vem de regras. Se humanos raciocinam com fatos e etapas, máquinas deveriam fazer o mesmo.

Isso levou a sistemas baseados em busca e planejamento, onde um problema era tratado como um espaço de estados. A inteligência, nesse modelo, era encontrar o caminho mais eficiente até um objetivo.

Métodos criados nessa época, como o algoritmo de Dijkstra, continuam sendo usados hoje em robótica, jogos e sistemas modernos.

Quando funcionava, a IA simbólica era fácil de entender. Máquinas conseguiam provar teoremas matemáticos ou jogar jogos estruturados.

O problema é que isso dependia de ambientes altamente controlados. O mundo real é cheio de exceções, ambiguidades e mudanças. Esses sistemas se tornavam frágeis fora de ambientes previsíveis.

Sistemas especialistas e o primeiro boom comercial

Um dos desdobramentos da IA simbólica foram os sistemas especialistas. Eles armazenavam conhecimento em grandes conjuntos de regras "se-então". A ideia era reproduzir o conhecimento de profissionais experientes.

Durante um período, esses sistemas pareciam prontos para uso comercial em áreas como medicina e negócios. Foi uma das primeiras vezes em que a IA parecia viável economicamente.

Mas surgiu um problema conhecido como gargalo de aquisição de conhecimento. Criar e manter milhares de regras era caro e demorado.

Quando os resultados ficaram abaixo das expectativas, ocorreu o primeiro "inverno da IA", período com queda no financiamento e no interesse.

- Leia tambem: Homem segue dica do ChatGPT para substituir o sal e acaba internado com intoxicação rara

A virada estatística: surge o Machine Learning

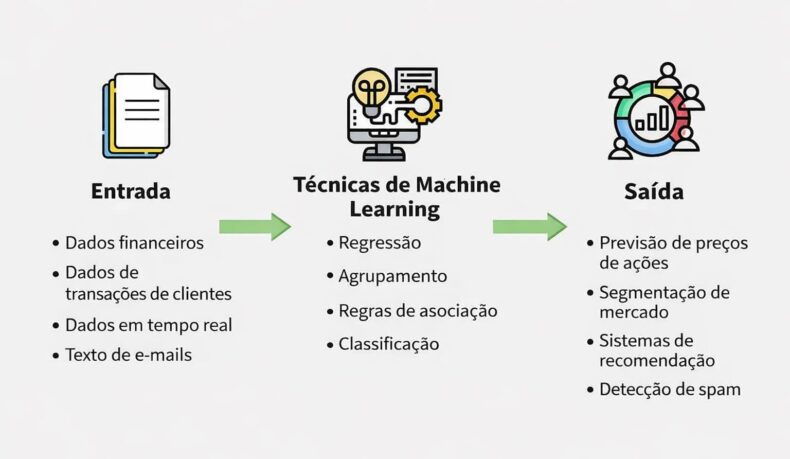

Com o tempo, a área mudou de pergunta. Em vez de ensinar inteligência diretamente, pesquisadores passaram a permitir que as máquinas aprendessem padrões a partir de dados.

Assim nasceu o Machine Learning (ou ML), que traduzido para o português significa "Aprendizado de máquina". Nessa fase surgiram modelos como árvores de decisão, máquinas de vetor de suporte (SVMs) e métodos ensemble.

Eles não tinham o apelo de "máquinas pensantes", mas funcionavam bem em tarefas reais, como detecção de fraude e classificação de dados.

O machine learning ganhou espaço porque tinha metas mais práticas: melhorar desempenho com mais dados.

Redes neurais: uma ideia antiga

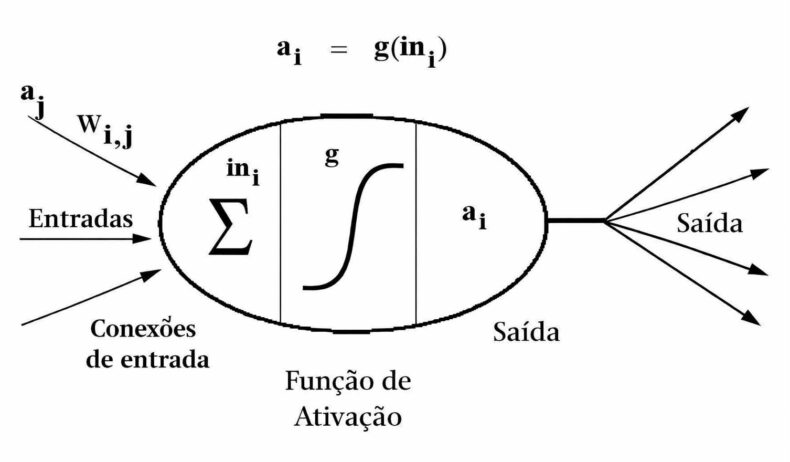

Apesar de parecerem recentes, redes neurais existem desde os anos 1940. O perceptron ganhou destaque nos anos 1950. A ideia era permitir que sistemas ajustassem seus próprios pesos e descobrissem representações.

O problema era a limitação de hardware e dados. Treinar redes profundas era difícil. A situação começou a mudar com técnicas como backpropagation e gradient descent, que viabilizaram redes com múltiplas camadas.

Mesmo assim, ainda faltava poder computacional. Esse padrão se repetiu várias vezes na história da IA: ideias surgem antes da tecnologia necessária.

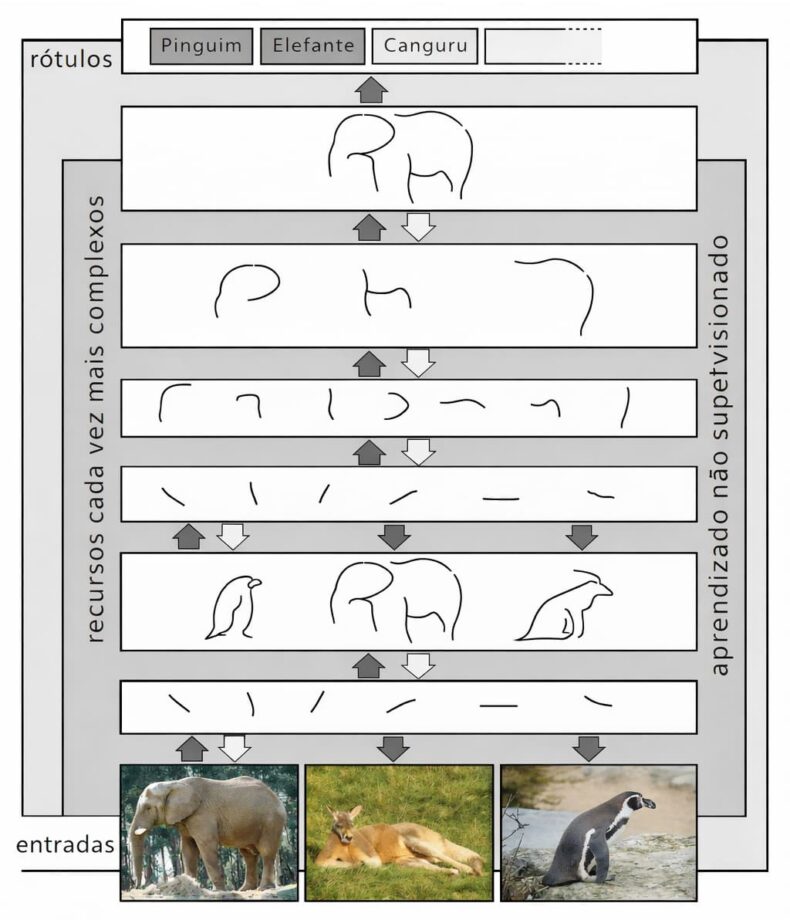

Deep learning: quando tudo se alinhou

Deep learning, ou aprendizado profundo, não é exatamente um novo tipo de IA. É o resultado de redes neurais maiores, mais dados e mais processamento.

O momento decisivo ocorreu em 2012 com o AlexNet, que superou o benchmark ImageNet. O modelo mostrou que GPUs podiam resolver problemas complexos de visão computacional.

GPUs, criadas para jogos, eram eficientes em multiplicação de matrizes e álgebra linear, fundamentais para redes neurais profundas.

Depois vieram Tensor Cores e aceleradores dedicados como TPUs, ampliando ainda mais o desempenho. Sem essa evolução de hardware, o deep learning provavelmente continuaria restrito à academia.

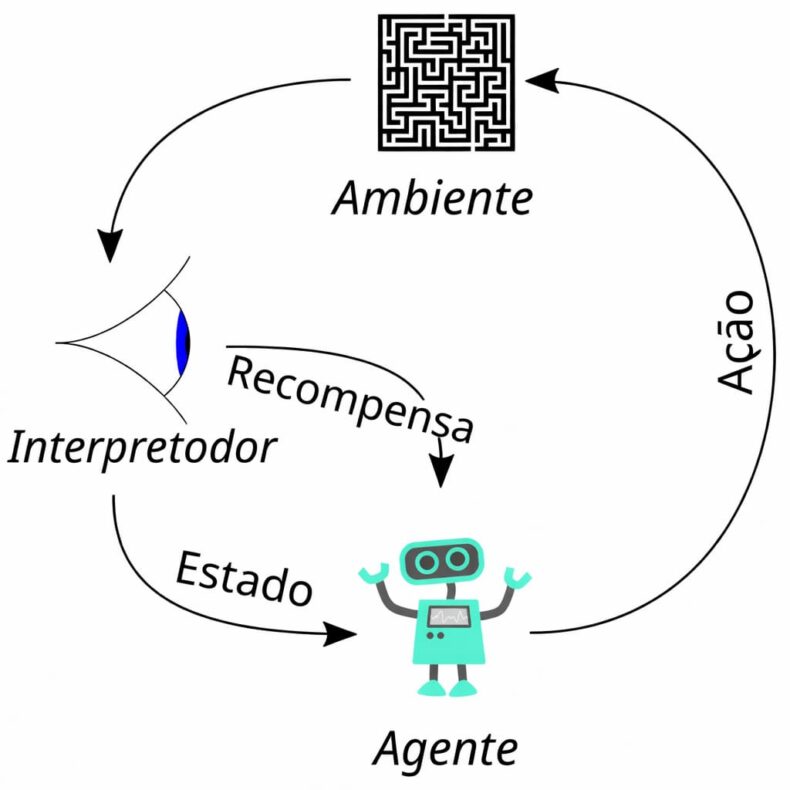

Aprendizado por reforço

Outra abordagem importante foi o aprendizado por reforço. Nela, um agente aprende por tentativa e erro, recebendo recompensas ou penalidades.

Um dos casos mais conhecidos foi o AlphaGo, que combinou redes neurais e busca para dominar o jogo Go. O sistema mostrou que métodos antigos e novos podiam ser combinados. Hoje, aprendizado por reforço é usado em robótica, otimização e treinamento de modelos.

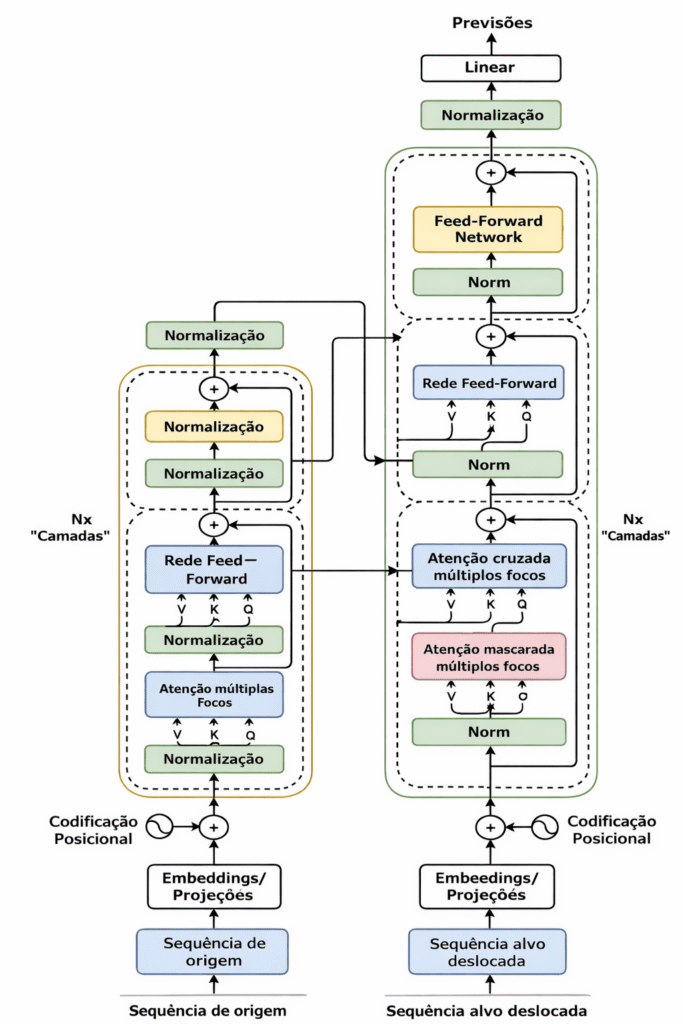

Era dos Transformers

O próximo avanço foi o Transformer. Antes disso, NLP usava redes recorrentes que processavam texto palavra por palavra. O artigo Attention Is All You Need introduziu o mecanismo de atenção, que analisa todos os tokens ao mesmo tempo.

Isso acelerou o treinamento e permitiu modelos maiores. Grande parte dos sistemas atuais, incluindo LLMs e modelos multimodais, surgiram a partir dessa arquitetura.

IA generativa

A IA generativa reúne várias técnicas como modelagem probabilística, difusão e pré-treinamento em larga escala. O objetivo é gerar conteúdo novo baseado em dados.

Modelos de linguagem se tornaram a face mais visível dessa evolução. O GPT-3, da OpenAI, mostrou que modelos maiores conseguem realizar tarefas sem treinamento específico.

No campo visual, modelos de difusão como Stable Diffusion popularizaram a geração de imagens. A linguagem natural também virou uma interface comum para interagir com computadores.

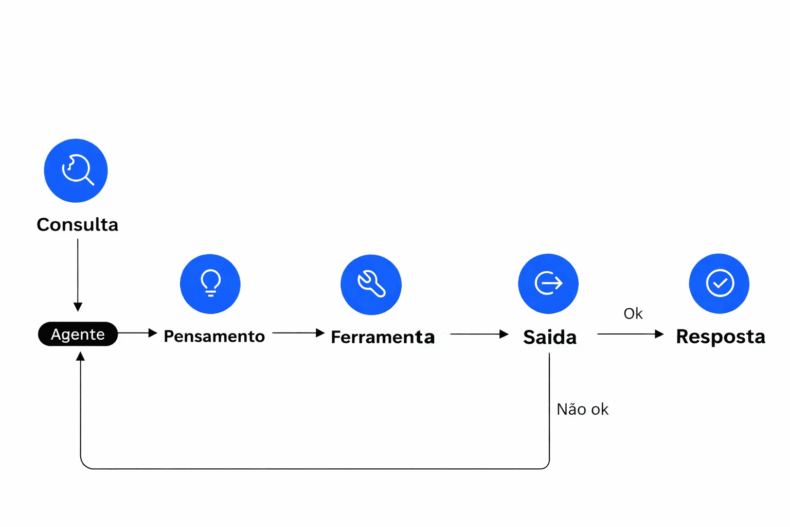

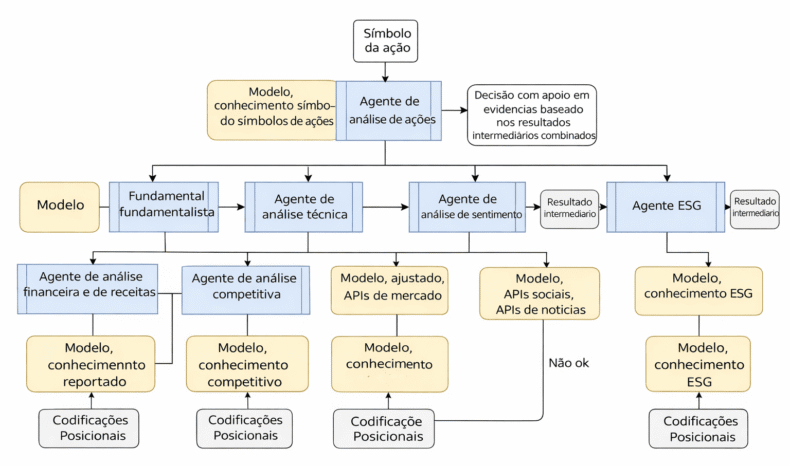

IA agentic

Se IA generativa cria conteúdo, IA agentic executa tarefas. Esses sistemas usam memória, ferramentas e planejamento para resolver problemas mais complexos.

Eles dividem objetivos em etapas, buscam informações e ajustam estratégias. Esse movimento lembra ideias antigas da IA simbólica. A diferença é que agora o "cérebro" são grandes modelos de linguagem.

Desafios atuais

Mesmo com avanços, a IA ainda tem suas limitações. Modelos modernos funcionam como caixas-pretas. Sistemas generativos podem criar informações incorretas.

Por isso, surgiram iniciativas como o National Institute of Standards and Technology AI Risk Management Framework e o Artificial Intelligence Act da European Commission, que entrou em vigor em 1º de agosto de 2024.

O que pode vir a seguir

O próximo avanço provavelmente será uma convergência de tecnologias. Sistemas mais multimodais, com memória persistente e integração com ferramentas.

Também há foco maior em eficiência, confiabilidade e integração com software. O futuro tende a combinar redes neurais com ferramentas simbólicas.

A história da IA mostra uma área que redefine constantemente o conceito de inteligência. A evolução saiu da lógica, passou por estatística, aprendizado profundo e chegou a sistemas generativos e agentic.

Cada fase resolveu problemas e trouxe novos desafios. Esse movimento indica que o próximo avanço deve surgir da combinação de abordagens já existentes, e não da substituição completa das tecnologias atuais.